Instagram wyświetli komunikaty o obraźliwych podpisach zdjęć

W tym roku Instagram wprowadził już powiadomienia o naruszaniu regulaminu podczas pisania komentarzy. Przed zamieszczeniem opinii użytkownik jest informowany, że treść tekstu może być niezgodna z wymaganiami serwisu.

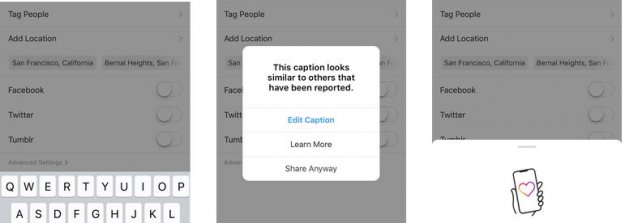

Nowe rozszerzenie aplikacji pozwoli dodatkowo wyświetlać komunikat o naruszeniu zasad podczas próby dodania fotografii z nieprawidłowym podpisem. Jeśli algorytmy bazujące na sztucznej inteligencji wykryją ewentualną mowę nienawiści czy podżeganie do kłótni lub słowa wskazujące np. na samookaleczanie, użytkownik dostanie odpowiednie powiadomienie. Podstawą do decyzji, czy dana treść jest szkodliwa, mają być zgłoszenia użytkowników poruszonych danymi opisami.

Zadaniem nowej funkcji nie jest blokowanie instagramowiczów, którzy zamieszczają obraźliwe treści, ale „danie im czasu do zastanowienia", czy na pewno są świadomi tego, co piszą i udostępniają. Po napisaniu szkodliwych słów użytkownicy dostaną informację, że „dane treści wyglądają podobnie do wcześniej raportowanych wątków" i będą mogli zadecydować, czy chcą edytować post. Będą też mogli wybrać opcję uzyskania szerszych informacji na temat łamania regulaminu.

Działania, jakie prowadzi Instagram, mają ograniczyć mowę nienawiści, dyskryminację oraz tyranizowanie innych użytkowników. Choć rozszerzenie aplikacji nie ma na celu blokowania osób piszących negatywne komentarze, to publikowane przez nie materiały mimo wszystko będą pod nadzorem, a one same będą mogły dwa razy przemyśleć, czy ślad, jaki chcą zostawić po sobie w sieci, na pewno jest potrzebny.

Uaktualnienie ma być wprowadzane globalnie w początkowych miesiącach 2020 roku.

fot. Instagram